Die Resultate

Als Benchmark-Software verwendeten wir unter Windows das bewährte iometer [7] . Wir skalierten die Last stufenweise von einem bis zu 30 Worker-Prozessen, von denen jeder mit 100 Prozent sequenziellem Lesen in 4K-Blöcken, ausgerichtet an 4K-Grenzen, beschäftigt war.

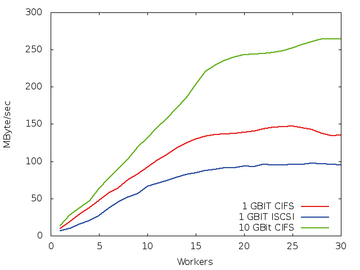

Alle Durchläufe, die beispielhaft Abbildung 6 zeigt, lasen von einer einzelnen SSD. Liefen die Zugriffe – egal ob CIFS oder iSCSI – über eine 1-GBit-Verbindung, so limitierte das Netzwerk den möglichen Durchsatz auf die maximal rund 125 MBit/s, die damit übertragbar sind.

Abbildung 6: Die Testresultate: Sequenzielles Lesen von einem SSD-Volume via CIFS und iSCSI mit 1 und 10 GBit/s.

Abbildung 6: Die Testresultate: Sequenzielles Lesen von einem SSD-Volume via CIFS und iSCSI mit 1 und 10 GBit/s.

Die 10-GBit-Verbindung erlaubt es dagegen, die Möglichkeiten der SSD besser auszuschöpfen. Weil der maximale Durchsatz der getesteten SSD von rund 500 MByte/s nur unter optimalen Bedingungen zu erreichen ist, liegen die gemessenen Werte nur bei der Hälfte. Das ergibt zum einen ein vermutlich praxisnäheres Bild als in speziell getunten Umgebungen für Hersteller-Benchmarks und zeigt andererseits, dass da noch Reserven sind, die – gegebenenfalls durch Trunkieren von mehreren 10-GBit-Ports – auch RAID-Gruppen aus SSDs unterstützen könnten. Synology selbst will in einem voll mit SSDs bestückten NAS dieser Bauart mit einem RAID5 aus allen SSDs und mit vierfach trunkierten Ethernet-Ports über 3000 MBytes/s beim Lesen gemessen haben.

Fazit

Große RAID-Gruppen mit Caches, Hybridplatten oder reine SSDs bringen mehr Daten auf die Leitung, als eine normale Gigabit-Verbindung verkraften kann. Das übergeorderte Netzwerk wirkt in diesem Fall als Bremse, worunter schließlich die Effizienz des Gesamtsystems leidet. Mit 10-GBit-Netzen, die gerade in letzter Zeit auch für kleinere Unternehmen erschwinglich geworden sind, lässt sich dieser Engpass erfolgreich umschiffen. Dank 10GBase-T können dabei sogar ähnliche Kabel und Switche verwendet werden, wie sie schon bisher im Einsatz waren.

Infos

- 10-GBit-Standard: http://ieeexplore.ieee.org/xpl/mostRecentIssue.jsp?reload=true&punumber=8064

- 10 GBit auf Kupfer: http://grouper.ieee.org/groups/802/3/ak/

- 10GBASE-T: http://standards.ieee.org/findstds/standard/802.3an-2006.html

- X540-T2: http://www.intel.com/p/de_DE/support/highlights/network/ecna-x540-t2

- RS 10613 XS+: http://www.synology.com/de-de/products/overview/RS10613xs%2B

- Netgear ProSafe XS708BE: http://www.netgear.de/products/business/switches/prosafe-plus-switches/XS708E.aspx#

- iometer: http://www.iometer.org